먼저 쉽게: AI 산업을 학교에 비유하면

AI 산업을 처음 접하는 분을 위해 비유로 시작합니다.

학교를 떠올려 보세요. 좋은 학교를 만들려면 무엇이 필요할까요? 훌륭한 선생님(모델)만으로는 안 됩니다. 교실 건물(데이터센터)이 있어야 하고, 전기와 냉방(전력 인프라)이 들어와야 하고, 교과서를 싸게 찍어서(추론 비용) 학생들에게 나눠줘야 하고, 실제로 학생이 등교해야(기업 도입) 학교가 돌아갑니다. 졸업 후 취업(운영)까지 돼야 학교의 가치가 증명됩니다.

AI 산업도 마찬가지입니다. 모델 랭킹(선생님 순위)만 보면 이 구조의 한 층만 보는 겁니다. 이 글에서는 AI 산업을 6개 층으로 나눠서 전체 구조를 봅니다.

AI 산업을 이해하려면 무엇을 봐야 할까요? 대부분의 독자는 모델 랭킹부터 찾습니다. GPT vs Claude vs Gemini, 벤치마크 점수, 새 모델 출시——이것만 따라가면 AI 산업을 파악한 기분이 듭니다. 하지만 모델 점수표는 AI 산업의 한 층일 뿐입니다. 실제 경쟁은 그 아래와 위에서 동시에 벌어지고 있습니다.

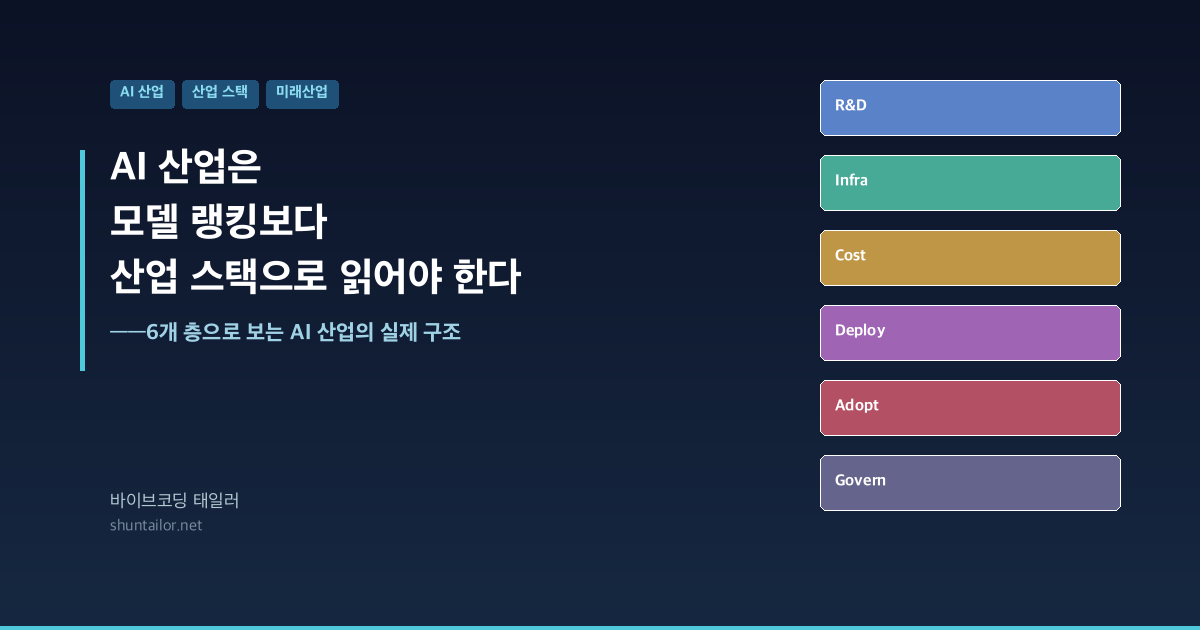

이 글은 미래산업 카테고리 2편입니다. AI 산업을 모델 랭킹이 아니라 6개 층의 산업 스택으로 읽는 법을 설명합니다. 이 프레임을 한 번 알고 나면, 같은 뉴스를 읽어도 보이는 것이 달라집니다.

모델 랭킹만 보면 무엇을 놓치는가

2024년 미국의 AI 민간 투자는 1,091억 달러입니다(Stanford HAI AI Index Report 2025). 생성형 AI에만 339억 달러가 몰렸습니다. 하지만 이 돈이 전부 모델 개발에 쓰이는 건 아닙니다. 데이터센터 건설, GPU 조달, 전력 계약, 냉각 설비, 네트워크 인프라——투자의 상당 부분이 모델 ‘아래’에 있는 인프라 층으로 갑니다.

280배 하락이 실제로 뭘 의미하는지를 구체적으로 봅니다. 2022년 말에 AI에게 질문 하나를 던지는 데 100원이 들었다고 합시다. 2024년 10월에는 같은 품질의 답변을 0.36원에 받을 수 있습니다. 기업 입장에서 보면, 같은 예산으로 280배 더 많은 AI 호출을 할 수 있게 된 것입니다. “월 100만 원으로 AI를 1만 번 쓸 수 있다”가 “월 100만 원으로 AI를 280만 번 쓸 수 있다”로 바뀐 겁니다.

이 변화가 왜 모델 성능보다 중요한가? 모델이 10% 더 똑똑해지면 답변의 질이 10% 올라갑니다. 하지만 비용이 280배 내려가면 사용량이 수십 배~수백 배 늘어납니다. 산업 규모에서는 “답변의 질 10% 개선”보다 “사용량 100배 증가”가 훨씬 큰 변화입니다.

GPT-3.5급 추론 비용은 2022년 말부터 2024년 10월까지 280배 이상 하락했습니다. 이 숫자는 모델 성능보다 추론 경제학이 산업화의 핵심 변수라는 뜻입니다. 아무리 좋은 모델이라도 추론 비용이 높으면 대규모 배포가 안 됩니다. 비용이 떨어져야 사용량이 폭발하고, 사용량이 폭발해야 기업 도입이 가속됩니다.

기업의 AI 도입률은 78%에 달합니다(Stanford HAI AI Index Report 2025). 하지만 “도입했다”와 “업무가 바뀌었다”는 전혀 다른 이야기입니다.

쉬운 비유: 집에 운동 기구를 사 놓는 것(도입)과 매일 운동하는 것(업무 변화)은 다릅니다. 78%의 기업이 “AI를 샀다”고 말했지만, 실제로 일하는 방식이 바뀐 기업은 훨씬 적습니다. “AI를 도입했다”는 보통 “ChatGPT 유료 구독을 시작했다” 수준인 경우가 많습니다. 이것은 실제 워크플로 변화가 아니라 도구 구매입니다.

진짜 워크플로 변화란 “이 부서의 이 프로세스에서 AI가 들어가서 작업 시간이 50% 줄었다”같은 것입니다. 이런 변화가 일어나려면 ④배포·제품과 ⑤운영 층이 함께 성숙해야 합니다. 도입률 78%가 실제 산업 변화 78%는 아닙니다. 이 간극이 ④⑤층이 아직 초기 단계라는 증거입니다.

“도입했다”와 “업무가 바뀌었다”는 전혀 다른 이야기입니다. 도입률 숫자만 보면 AI가 이미 모든 기업에 퍼진 것 같지만, 실제로 워크플로가 바뀐 기업은 훨씬 적습니다. 이 간극이 바로 배포·제품 층(④)과 운영 층(⑤)이 아직 성숙하지 않았다는 증거입니다.

비자명한 포인트: 모델 성능 격차는 점점 줄어들고 있습니다. 2024년 주목할 AI 모델의 약 90%가 기업에서 나왔고(Stanford HAI), 프론티어 모델 간 벤치마크 차이가 줄수록 경쟁의 중심은 모델 바깥으로 이동합니다. 배포 비용, 전력 확보, 기업 워크플로 통합, 에이전트 운영——이런 ‘모델 아래와 위’의 층이 사업 우위를 더 오래 만드는 시대로 접어들고 있습니다.

AI 산업을 읽는 6개 층

AI 산업은 다음 6개 층이 동시에 움직이는 스택입니다. 모델 랭킹은 이 중 1번 층의 결과물일 뿐입니다.

건물로 비유합니다. 6층 건물을 짓는다고 생각하세요. 1층(R&D)은 설계도입니다. 좋은 설계도가 있어야 좋은 건물이 나옵니다. 하지만 설계도만으로는 건물이 안 됩니다. 2층(인프라)은 기초 공사와 철근입니다. 3층(추론 경제학)은 건축 자재 가격입니다. 자재가 비싸면 큰 건물을 못 짓습니다. 4층(배포·제품)은 실제로 사람이 입주하는 단계입니다. 5층(운영)은 건물 관리입니다. 입주 후 엘리베이터가 고장나면 좋은 건물도 무너집니다. 6층(거버넌스)은 건축 법규입니다. 법규를 안 지키면 건물을 지을 수 없습니다.

모델 랭킹만 보는 것은 설계도(1층)만 비교하면서 “이 건물이 더 좋다”고 판단하는 것과 같습니다. 설계도가 아무리 좋아도, 기초 공사(인프라)가 부실하거나, 자재(추론 비용)가 비싸거나, 입주자(기업 도입)가 없으면 의미가 없습니다.

AI 산업 6층 스택

모델 랭킹은 ①의 결과물. 산업 경쟁은 6개 층에서 동시에 진행된다

개발자/전문가가 놓치기 쉬운 포인트

개발자가 익숙한 OSI 7 Layer와 비교하면 이 6층 스택의 구조가 명확해집니다. OSI에서 Application Layer(HTTP)만 보면 Transport(TCP)나 Physical Layer(이더넷 케이블)를 놓치듯, AI 산업에서 모델(Application Layer)만 보면 인프라(Physical Layer)와 추론 경제학(Transport Layer)을 놓칩니다. 네트워크 엔지니어가 “패킷이 왜 느리냐”고 할 때 각 층을 위에서 아래로 디버깅하듯, AI 산업 뉴스도 “이 이슈가 6층 중 어디에 해당하는가?”로 읽으면 구조가 보입니다. 각 층이 독립적이면서 상호 의존하는 구조는 동일합니다.

① 연구개발: 모델 랭킹이 만들어지는 곳

R&D 층에서 실제로 무슨 일이 일어나는가

아키텍처란 AI 모델의 기본 설계 구조입니다. 건물로 치면 “몇 층짜리, 어떤 구조의 건물을 짓는가”에 해당합니다. 2017년에 나온 트랜스포머(Transformer) 아키텍처가 현재 거의 모든 대형 AI 모델의 기반입니다. GPT, Claude, Gemini, Llama 모두 트랜스포머 구조 위에 세워졌습니다. 아키텍처가 바뀌면 그 위의 모든 것(학습 방법, 데이터 전략, 추론 구조)이 따라서 바뀝니다.

학습 방법론은 “이 설계 구조를 어떤 데이터로 어떻게 훈련시키는가”입니다. 같은 아키텍처라도 훈련 데이터, 훈련 기간, 강화학습 방법에 따라 결과가 크게 달라집니다. OpenAI, Anthropic, Google이 각각 다른 훈련 방법을 쓰기 때문에 같은 트랜스포머 기반이라도 GPT, Claude, Gemini가 다른 성격을 가집니다.

데이터 전략은 “무엇을 먹이는가”입니다. AI 모델은 훈련 데이터의 질과 양에 크게 의존합니다. 좋은 데이터를 많이 확보하는 것 자체가 경쟁력입니다. 그래서 데이터 확보, 저작권 문제, 합성 데이터 생성이 R&D 층의 핵심 쟁점입니다.

트랜스포머 아키텍처, 학습 방법론, 데이터 전략이 이 층의 핵심입니다. 2024년 주목할 AI 모델의 약 90%가 기업에서 나왔습니다(Stanford HAI). 학계가 아니라 기업이 R&D의 중심입니다.

모델 랭킹은 이 층에서 나오는 결과물이지, AI 산업 전체의 성적표가 아닙니다.

왜 “90%가 기업에서”가 중요한가. 10년 전만 해도 AI 연구의 중심은 대학이었습니다. 논문을 쓰고, 학회에서 발표하고, 그 기술이 수년 뒤 산업에 적용되는 흐름이었습니다. 지금은 기업이 직접 연구하고, 제품으로 바로 배포합니다. 이것은 AI가 “학문”에서 “산업”으로 넘어갔다는 뜻입니다. 산업이 된 이상, 연구 성과(모델 점수)만으로 기업의 강함을 판단할 수 없습니다. 삼성이 반도체 시장에서 강한 이유는 “연구 논문을 많이 썼기 때문”이 아니라 “팹을 안정적으로 돌리기 때문”입니다. AI 기업도 마찬가지입니다.

OpenAI, Anthropic, Google이 모두 프론티어 모델을 만들지만, 어떤 기업이 산업에서 더 강한지는 모델 점수만으로 판단할 수 없습니다. 모델은 스택의 첫 번째 층이지, 유일한 층이 아닙니다.

② 인프라: 확장 속도를 물리적으로 결정하는 곳

GPU 조달, 데이터센터 건설, 냉각 설비, 전력 계약, 네트워크——이 층이 AI 산업의 확장 속도를 실제로 결정합니다. 1편에서 설명한 “느린 층”이 바로 여기입니다.

데이터센터가 “건물”이 아니라 “발전소급 전력 소비자”인 이유

“데이터센터”라는 단어에서 “센터”에 속으면 안 됩니다. 쇼핑센터처럼 사람이 드나드는 건물이 아닙니다. 실제로는 수만 대의 서버가 24시간 전기를 먹는 거대한 전력 소비 시설입니다.

왜 이렇게 전기를 많이 쓰나요? 단계별로 봅니다.

- 서버가 전기를 쓴다 (~60%). GPU, CPU, 메모리, 스토리지가 계산을 합니다. AI 모델 하나를 돌리는 데 GPU 한 장이 300~700W를 씁니다. 데이터센터 하나에 GPU가 수만 장 있으니, 서버만으로도 소도시급 전기를 씁니다.

- 서버가 열을 낸다 → 냉각이 전기를 쓴다 (~25%). 전기가 흐르면 열이 납니다. GPU 수만 장이 동시에 열을 내면 온도가 급상승합니다. 이 열을 식히지 않으면 서버가 멈추거나 고장납니다. 냉각 시스템(에어컨, 수냉, 액침냉각)이 전기를 써서 열을 빼냅니다. 서버를 2배 늘리면 냉각도 2배 이상 늘어나야 합니다(열은 비선형으로 증가).

- 외부 전기를 서버용으로 바꿔야 한다 → 전력 변환이 전기를 쓴다 (~10%). 발전소에서 오는 전기(고압 교류)를 서버가 쓸 수 있는 전기(저압 직류)로 바꾸는 과정에서 에너지가 손실됩니다. 이 변환 장비(변압기, UPS, PDU)도 전기를 씁니다.

- 나머지 (~5%). 조명, 보안, 화재 감지, 백업 발전기 등.

핵심: 서버(GPU)만 보면 전력의 60%만 보입니다. 실제 데이터센터 전력은 서버 + 냉각 + 변환 + 기타를 합한 것입니다. 그래서 “GPU를 몇 장 샀는가”보다 “총 전력을 얼마나 확보했는가”가 데이터센터 경쟁의 진짜 변수입니다.

데이터센터는 건물이 아니라 대규모 전력 소비 시설입니다. 서버가 전체 전력의 약 60%를 소비하고, 나머지 40%는 냉각, 전력 변환, 백업 전원, 네트워크에 씁니다. 변압기 리드타임 2~3년, 인터커넥션 큐 수년 대기.

이것이 왜 ②인프라 층의 핵심인가. GPU(서버)는 발주하면 수개월에 도착합니다. 하지만 그 GPU를 돌릴 전기를 보내는 변압기는 수년이 걸립니다. 즉, AI 산업의 확장 속도를 결정하는 건 GPU 배송 속도가 아니라 전력 장비 설치 속도입니다. 서버(빠름)와 전력(느림)의 시간 미스매치가 ②인프라 층이 존재하는 근본 이유입니다.

4편에서 이 메커니즘을 숫자로 상세히 봅니다. 데이터센터는 1~3년이면 짓지만, 전력을 연결하는 데 5~15년이 걸릴 수 있습니다. 아무리 좋은 모델을 만들어도, 아무리 많은 GPU를 사도, 전력이 부족하면 서비스를 확장할 수 없습니다.

왜 GPU만으로는 안 되는가——인프라는 “시스템”이다

이것을 자동차로 비유합니다. 최고급 엔진(GPU)을 만들었다고 합시다. 하지만 엔진만 있으면 차가 달리나요? 변속기(네트워크), 냉각 시스템(데이터센터 냉각), 연료 공급(전력), 도로(전력망)가 모두 있어야 달립니다. 엔진이 아무리 좋아도 도로가 없으면 못 달립니다.

데이터센터도 마찬가지입니다. GPU(엔진)는 전체 전력의 일부만 씁니다. 나머지는 냉각(서버가 발생시키는 열을 식히는 장비), 전력 변환(외부 전기를 서버가 쓸 수 있는 전압으로 바꾸는 장비), 네트워크(GPU끼리 데이터를 주고받는 통로), 백업 전원(정전 시 데이터를 보호하는 장비)에 씁니다.

NVIDIA가 GPU뿐 아니라 데이터센터 네트워킹(InfiniBand, NVLink)과 냉각 솔루션까지 확장하는 이유가 여기에 있습니다. 엔진(GPU)만 팔아서는 안 됩니다. 차 전체(인프라 시스템)가 따라줘야 엔진이 제대로 작동합니다. 마찬가지로 Microsoft, Google, Amazon이 수십조 원 규모의 데이터센터 투자를 발표하는 이유도 모델 개발이 아니라 인프라 확보입니다.

개발자/전문가가 놓치기 쉬운 포인트

GPU 클러스터의 병목은 연산이 아니라 네트워크 대역폭(interconnect bandwidth)인 경우가 많습니다. 대규모 모델 학습에서 GPU간 텐서 동기화(all-reduce)가 전체 학습 시간의 30~50%를 차지할 수 있습니다. NVIDIA가 InfiniBand와 NVLink에 투자하는 이유가 여기에 있습니다. 분산 시스템을 설계해 본 개발자라면 “컴퓨팅보다 통신이 병목”이라는 Amdahl’s Law의 통신 버전을 체감할 것입니다. 이것이 인프라 층이 단순한 “GPU 조달”이 아니라 네트워크·냉각·전력을 포함하는 시스템 엔지니어링인 이유입니다.

③ 추론 경제학: 사용량 폭발의 열쇠

모델이 아무리 뛰어나도 추론 비용이 높으면 대규모 배포가 안 됩니다. GPT-3.5급 추론 비용 280배 하락이 의미하는 건, 같은 품질의 AI를 280배 더 많은 곳에서 쓸 수 있게 됐다는 것입니다.

피드백 루프: 좋은 소식이 새 문제를 만드는 구조

AI 산업의 핵심 메커니즘을 단계별로 봅니다.

- 추론 비용이 내려간다 — GPT-3.5급 280배 하락

- 사용량이 폭발한다 — 같은 예산으로 280배 더 쓸 수 있으니

- 기업이 도입한다 — “이 가격이면 우리도 쓸 수 있다” (도입률 78%)

- 데이터센터가 늘어난다 — 사용량을 감당하려면 서버가 더 필요

- 인프라 투자가 늘어난다 — Microsoft, Google, Amazon이 수십조 원 투자 발표

- 규모의 경제로 비용이 더 내려간다 — 인프라가 커지면 단위 비용 감소 → 1번으로 돌아감

여기까지만 보면 완벽한 선순환입니다. 하지만 동시에 반대쪽에서 문제가 생깁니다.

- 전력 수요가 급증한다 — 460TWh → 1,300TWh (4편 참조)

- 장비와 연결이 못 따라간다 — 변압기 4년, 큐 2,500GW (4편 참조)

- 투자 발표와 실제 가동 사이에 간극이 생긴다

즉, 1~6은 “가속 페달”이고, 7~9는 “브레이크”입니다. AI 산업을 이해하려면 가속 페달(좋은 소식)과 브레이크(물리적 제약)를 동시에 봐야 합니다. 가속만 보면 지나치게 낙관적이고, 브레이크만 보면 지나치게 비관적입니다. 이 양면성을 이해해야 뉴스를 정확하게 읽을 수 있습니다.

왜 추론 비용이 모델 성능보다 산업적으로 더 중요한가

이것을 식당으로 비유합니다. 세계 최고의 셰프(최고 성능 모델)가 한 그릇에 100만 원짜리 요리를 만든다고 합시다. 맛은 최고지만, 이 가격에 매일 올 손님은 극소수입니다. 같은 셰프가 한 그릇 5,000원짜리 메뉴를 만들 수 있다면? 손님이 폭발합니다. 식당이 체인으로 퍼집니다.

AI도 같습니다. GPT-4급 모델이 아무리 뛰어나도 추론 비용이 높으면 대규모 배포가 안 됩니다. Anthropic이 Claude Haiku를, OpenAI가 GPT-4o mini를 만든 이유가 여기에 있습니다. 최고 성능 모델(100만 원 요리)만으로는 시장이 커지지 않습니다. 비용이 낮은 모델(5,000원 메뉴)이 사용량을 폭발시키고, 사용량이 폭발해야 기업이 도입하고, 기업이 도입해야 산업이 됩니다.

1편에서 설명한 제본스 역설이 여기서도 작동합니다. 추론 비용이 280배 내려가면, 기업은 “이제 아껴서 쓰자”가 아니라 “모든 곳에 넣자”가 됩니다. 그 결과 총 사용량이 폭발하고, 데이터센터 수요가 급증하고, 전력 수요가 급증합니다. AI의 “좋은 소식”(비용 하락)이 에너지의 “새로운 문제”(전력 부족)를 만드는 구조입니다.

“새 모델이 나왔다”보다 “추론 비용이 얼마나 내려갔는가”가 산업적으로는 더 큰 뉴스입니다. 비용이 내려가야 기업이 도입하고, 기업이 도입해야 시장이 커집니다. Anthropic이 Claude Haiku를 내놓은 이유, OpenAI가 GPT-4o mini를 만든 이유가 다 여기에 있습니다. 최고 성능 모델만으로는 시장을 키울 수 없습니다.

개발자/전문가가 놓치기 쉬운 포인트

API pricing을 설계해 본 개발자라면 이 체인이 직관적으로 와닿을 것입니다. 추론 비용 = API 가격 → API 가격 = 사용량 → 사용량 = 인프라 수요. Stripe의 per-transaction fee가 결제 횟수를 결정하고, 결제 횟수가 서버 비용을 결정하는 것과 같은 구조입니다. GPT-3.5급 추론 비용이 280배 하락했다는 건, 같은 예산으로 API를 280배 더 호출할 수 있다는 뜻입니다. 이것은 클라우드 컴퓨팅에서 AWS Lambda가 per-invocation 과금으로 서버리스 시대를 연 것과 같은 패러다임 전환입니다. 비용 구조가 사용 패턴을 결정하고, 사용 패턴이 인프라 수요를 결정합니다.

④ 배포·제품: 가치가 실현되는 곳

기업의 AI 도입률은 78%이지만, “도입했다”와 “워크플로가 바뀌었다”는 다른 이야기입니다. Claude Code, Cursor, Devin 같은 코딩 에이전트가 개발자 워크플로를 실제로 바꾸고 있고, 이 층에서의 경쟁이 갈수록 치열해지고 있습니다.

왜 “어떤 모델”보다 “어떻게 배포하느냐”가 더 중요해지는가

비유로 설명합니다. 커피 원두(모델)의 품질 차이가 줄어들면, 경쟁은 어디로 가나요? 카페의 위치, 인테리어, 서비스 속도, 앱 주문 편의성——즉 “원두를 어떻게 손님에게 전달하느냐”로 경쟁이 이동합니다.

AI도 같습니다. GPT-4, Claude, Gemini의 벤치마크 차이가 줄어들수록, 경쟁은 “이 모델을 실제 업무에 어떻게 끼워 넣느냐”로 이동합니다. Claude Code가 개발자의 로컬 파일에 직접 접근하는 것, Cursor가 에디터 안에서 AI를 호출하는 것, ChatGPT가 대화 인터페이스로 일반인에게 접근하는 것——각각 다른 “배포 방식”입니다. 같은 원두(비슷한 모델)지만, 카페(제품 경험)가 다릅니다.

에이전트 도구의 폭발적 증가는 이 구조 변화의 증거입니다. 모델 성능이 평준화되면서 경쟁이 “모델 → 제품·워크플로 통합”으로 이동하고 있습니다. 어떤 모델을 쓰느냐보다, 그 모델을 어떻게 배포하고 어떤 워크플로에 끼워 넣느냐가 비즈니스 차별화를 만듭니다.

세 기업의 배포 전략이 왜 다른가

같은 “AI 서비스를 만든다”인데 왜 방식이 다를까요? 각 기업이 가진 기존 자산이 다르기 때문입니다.

- OpenAI: AI 모델(①)은 최고 수준이지만, 기존 사용자 기반이 없었습니다. 그래서 ChatGPT라는 독립 제품을 만들어서 직접 사용자를 모았습니다. 제로에서 시작해서 사용자를 끌어오는 전략입니다.

- Anthropic: 마찬가지로 모델(①)이 강하지만, 개발자 시장을 노렸습니다. Claude Code와 MCP(Model Context Protocol)를 만들어서 개발자의 기존 워크플로에 침투하는 전략입니다. 개발자가 이미 쓰는 에디터, 터미널, 저장소 안에 들어가는 것입니다.

- Google: 이미 검색, Gmail, Docs, Android라는 수십억 명의 사용자 기반이 있습니다. Gemini를 이 기존 제품 안에 통합하는 전략입니다. 새 앱을 만들 필요 없이, 사용자가 이미 매일 쓰는 제품에 AI를 삽입합니다.

OpenAI가 ChatGPT라는 제품을 만든 건 모델(GPT-4)만으로는 부족했기 때문입니다. Anthropic이 Claude Code와 MCP를 만든 건 모델(Claude)을 개발자 워크플로에 실제로 심기 위해서입니다. Google이 Gemini를 검색·워크스페이스·안드로이드에 통합하는 건 기존 제품 안에서 AI 가치를 실현하기 위해서입니다. 이 층에서의 승부가 결국 누가 시장을 키우는가를 결정합니다.

개발자/전문가가 놓치기 쉬운 포인트

DevOps에서 CI/CD가 코드 배포를 바꾼 것처럼, AI의 배포 층은 “모델을 실제 워크플로에 끼워 넣는 Continuous Deployment”에 해당합니다. 하지만 결정적 차이가 있습니다. 코드 배포는 한 번 하면 추가 비용이 거의 없지만, AI 배포는 추론마다 비용이 발생합니다. git push 한 번에 배포가 끝나는 게 아니라, 사용자가 쓸 때마다 “배포 비용”이 계속 발생하는 셈입니다. 이것은 SaaS의 COGS(매출원가)가 거의 0인 것과 AI 제품의 COGS가 사용량에 비례하는 것의 차이이며, AI 비즈니스 모델을 기존 SaaS와 근본적으로 다르게 만드는 요인입니다.

⑤ 운영: 품질을 지속시키는 곳

AI를 한 번 배포하는 건 쉽습니다. 지속적으로 품질을 유지하는 건 어렵습니다. 가이던스(AGENTS.md, DESIGN.md 같은 에이전트 지시 문서), 평가(벤치마크, 실무 테스트), 관찰가능성(로그, 모니터링), 보안——이 층이 약하면 배포한 AI가 금방 무너집니다.

왜 운영이 중요한지를 음식점으로 비유합니다. 좋은 레시피(모델)로 맛있는 음식을 한 번 만드는 건 쉽습니다. 하지만 매일 같은 맛을 유지하려면? 재료 관리(데이터 품질), 위생 점검(보안), 손님 피드백 반영(평가 루프), 주방 모니터링(관찰가능성)이 필요합니다. 이 시스템이 없으면 맛이 매일 달라지고, 결국 손님이 떠납니다.

AI도 마찬가지입니다. AI를 한 번 배포하는 건 쉽지만, 매일 같은 품질을 유지하려면 AGENTS.md(레시피 표준화), 검증 루프(위생 점검), 모니터링(주방 감시)이 필요합니다. 이 블로그에서 다뤄 온 에이전트 설계, 하네스 엔지니어링, DESIGN.md 같은 주제가 바로 이 “주방 관리 시스템”에 해당합니다.

모델 랭킹에는 안 나오지만, 실무에서는 이 층이 결과의 차이를 만듭니다. 같은 모델(같은 레시피)을 쓰더라도 운영 층(주방 관리)이 탄탄한 팀과 그렇지 않은 팀의 결과물은 크게 다릅니다.

개발자/전문가가 놓치기 쉬운 포인트

전통적 소프트웨어에서 Observability(관측가능성)는 로그·메트릭·트레이스 3축입니다. AI 운영에서는 여기에 “모델 품질 드리프트 감지”라는 4번째 축이 추가됩니다. 코드는 배포 후 동작이 결정적(deterministic)이지만, AI 모델은 입력 데이터 분포가 바뀌면 같은 모델이 다른 결과를 냅니다. 이것을 data drift라고 합니다. 기존 APM(Datadog, New Relic)으로는 이 문제를 잡을 수 없습니다. 이것이 MLOps가 DevOps의 단순 확장이 아니라 별도 학문이 된 이유입니다.

⑥ 거버넌스: 산업의 속도와 방향을 조율하는 곳

⑥ 거버넌스가 실제로 산업에 미치는 영향

거버넌스 층이 “먼 이야기”처럼 느껴질 수 있지만, 실제로 기업의 제품 전략을 직접 바꿉니다. 구체 사례:

- EU AI Act (2024~): AI 시스템을 위험 등급으로 분류합니다. “고위험”으로 분류되면 투명성 보고서, 감사 의무가 생깁니다. 이 규제 때문에 OpenAI와 Google이 EU 시장에 일부 기능을 제한하거나 별도 버전을 만들어야 합니다.

- 저작권 소송: AI 훈련 데이터에 저작권 콘텐츠를 사용한 것에 대한 소송이 미국에서 진행 중입니다. 결과에 따라 훈련 데이터 확보 방식(①R&D)이 바뀔 수 있습니다.

- 미국 행정 명령 (2023): AI 안전 테스트, 보고 의무를 부과했습니다. 대형 모델을 공개하기 전에 안전 테스트 결과를 정부에 제출해야 합니다.

안전, 규제, 저작권, 노동 전환——기술 뉴스에서는 뒤로 밀리지만, 산업 규모에서는 이 층이 전체 방향을 결정합니다. EU의 AI Act, 미국의 행정 명령, 각국의 AI 안전 연구소 설립——이런 움직임이 기업의 배포 전략과 속도를 직접 바꿉니다.

왜 규제가 “브레이크”가 아니라 “신호등”인가. 규제를 차의 브레이크로 비유하면 “성장을 멈추는 것”으로 보입니다. 하지만 실제로는 교차로의 신호등에 가깝습니다. 신호등이 없으면 차가 더 빨리 달릴 수 있을까요? 아닙니다. 사고가 나서 더 느려집니다. 신호등(규제)은 모든 참가자가 안전하게 움직이도록 조율하는 장치입니다.

AI 관련 사건(환각, 편향, 저작권 분쟁)과 규제(EU AI Act, 미국 행정 명령)가 동시에 늘고 있다는 건, AI가 연구실에서 사회로 나가면서 “교차로”가 많아지고 있다는 뜻입니다. 교차로가 많아지면 신호등도 많아져야 합니다. 이 마찰은 산업 성장을 막는 것이 아니라, 방향과 속도를 조율하는 기능을 합니다.

기업을 스택으로 읽기: 같은 뉴스, 다른 관점

주요 기업이 강한 층은 어디인가

| 기업 | 가장 강한 층 | 확장 중인 층 |

|---|---|---|

| NVIDIA | ② 인프라 (GPU, 네트워크) | ④ 배포 (NIM, 엔터프라이즈) |

| OpenAI | ① R&D (GPT 시리즈) | ④ 배포 (ChatGPT, Codex) |

| Anthropic | ① R&D + ⑤ 운영 (안전) | ④ 배포 (Claude Code, MCP) |

| ② 인프라 (TPU, 클라우드) | ④ 배포 (Gemini 통합) | |

| Microsoft | ② 인프라 (Azure) + ④ 배포 | ④ Copilot 생태계 확장 |

| Meta | ① R&D (Llama 오픈소스) | ④ 배포 (앱 내 AI 통합) |

기업 뉴스를 볼 때 “이 기업은 6층 중 어디에서 싸우고 있는가”를 먼저 확인하면 전략이 보인다

이 표에서 읽어야 할 3가지 패턴

패턴 1: 모든 기업이 ④배포·제품 층으로 확장 중. 왜? 모델 성능이 비슷해지면 “어떻게 쓰게 만드느냐”가 차별화가 되기 때문입니다. 커피 원두(모델)의 맛이 비슷해지면 카페(제품 경험)에서 승부가 나는 것과 같습니다.

패턴 2: 출발점에 따라 확장 방향이 다릅니다. NVIDIA와 Google은 인프라(②)에서 시작해서 제품(④)으로 올라가고, OpenAI와 Anthropic은 R&D(①)에서 시작해서 제품(④)으로 내려옵니다. 출발점이 다르면 강점과 약점도 다릅니다. NVIDIA는 GPU 생태계가 강하지만 직접 AI 서비스는 약하고, OpenAI는 모델이 강하지만 자체 인프라는 Microsoft에 의존합니다.

패턴 3: ②인프라를 직접 가진 기업이 유리합니다. 4편에서 봤듯이 전력과 데이터센터가 확장의 물리적 제한입니다. Google(자체 TPU + 대규모 DC), Microsoft(Azure), Amazon(AWS)처럼 인프라를 직접 가진 기업이 “전력 확보 경쟁”에서 유리합니다. OpenAI와 Anthropic은 모델은 강하지만 인프라를 파트너에 의존하므로, 확장 속도가 파트너의 인프라에 묶입니다.

이 표를 보면 몇 가지가 보입니다. 첫째, 모든 기업이 ④배포·제품 층으로 확장하고 있습니다. 모델 경쟁만으로는 부족하다는 걸 기업들이 이미 알고 있다는 뜻입니다. 둘째, NVIDIA와 Google/Microsoft는 ②인프라에서 출발한 기업이고, OpenAI/Anthropic은 ①R&D에서 출발한 기업입니다. 출발점이 다르면 확장 방향도 다릅니다.

메커니즘: 비용 하락 → 사용량 폭발 → 인프라 병목의 피드백 루프

AI 산업에서 가장 중요한 메커니즘 하나를 꼽으라면 이 피드백 루프입니다.

- 추론 비용이 내려간다 → GPT-3.5급 280배 하락처럼

- 사용량이 폭발한다 → 같은 비용으로 280배 더 많은 곳에서 AI를 쓸 수 있으니

- 인프라 투자가 늘어난다 → 수요를 따라 데이터센터 건설, GPU 구매 가속

- 규모의 경제로 비용이 더 내려간다 → 인프라가 커지면 단위 비용이 줄어

- 하지만 동시에 전력 수요도 급증한다 → 인프라 병목이 드러나고

- 병목이 확장 속도를 제한한다 → 변압기 2~3년, 전력 연결 수년 대기

이 루프를 이해하면, “왜 AI 기업이 수십조를 투자하면서도 확장이 느린지”, “왜 추론 비용 하락이 오히려 전력 위기를 부르는지”가 납득됩니다. 좋은 소식(비용 하락)이 새로운 문제(인프라 부족)를 만드는 구조입니다.

AI 뉴스를 6층으로 읽는 실전 체크리스트

새 AI 뉴스를 읽을 때 다음 6개 질문을 던져 보세요. 이 질문들은 “와, 대단하다”에서 끝나는 5분짜리 뉴스 읽기를, “이 발표가 실제로 산업에 어떤 의미인가”를 판단하는 15분짜리 읽기로 바꿔줍니다.

처음에는 6개 질문을 다 던지기 어렵습니다. 하나부터 시작하세요. “이 발표가 6층 중 어느 층의 이야기인가?”만 판단해도 뉴스를 읽는 깊이가 달라집니다.

| 층 | 질문 |

|---|---|

| ① 연구개발 | 이 모델/기술은 기존 대비 무엇이 달라졌는가? (예: “Claude 4가 나왔다” → “어떤 아키텍처 변화인가?”) |

| ② 인프라 | 이걸 대규모로 돌리려면 어떤 인프라가 필요한가? (예: “이 모델을 돌리는 DC의 전력은 확보됐나?”) |

| ③ 추론 경제학 | 추론 비용은 얼마나 내려갔는가? (예: “Haiku급 저비용 모델이 같이 나왔나?”) |

| ④ 배포·제품 | 어떤 제품/워크플로에 실제로 들어가는가? (예: “이 모델이 ChatGPT/API/Claude Code 중 어디에 먼저 들어가나?”) |

| ⑤ 운영 | 배포 후 품질을 어떻게 유지하는가? (예: “안전 가이드라인, 평가 하네스, 모니터링 도구가 업데이트됐나?”) |

| ⑥ 거버넌스 | 규제나 안전 이슈가 이 배포를 바꿀 수 있는가? (예: “EU AI Act에서 이 서비스는 어떤 등급인가?”) |

이 6개 질문을 습관으로 만들면, 모델 출시 뉴스 하나가 6개 관점으로 펼쳐집니다. 점수 비교에 쓰던 시간이 산업 구조 이해로 바뀝니다.

각 층을 더 깊이 이해하기: 왜 GPU만으로는 안 되는가

변압기와 인터커넥션 큐: ②인프라 층의 물리적 제약

GPU(서버)는 발주하면 수개월에 도착합니다. 하지만 그 GPU를 돌릴 전기를 보내는 변압기는 맞춤 제작이라 최대 4년이 걸립니다. 왜 이렇게 오래 걸리나? 대형 변압기는 무게가 200~400톤이고, 특수강(방향성 전기강판)을 사용하며, 설치 위치의 전압·용량에 맞춰 개별 설계됩니다. “공장에서 찍어내는 규격품”이 아닙니다.

인터커넥션 큐(전력망 연결 대기줄)에는 현재 2,500GW 이상이 대기 중입니다. 데이터센터, 태양광 발전소, 배터리 저장 시설이 모두 같은 줄에 서 있습니다. 큐를 처리하는 속도가 프로젝트가 쌓이는 속도를 따라가지 못합니다.

이것이 왜 중요한가: 아무리 좋은 AI 모델을 만들어도, 아무리 많은 GPU를 사도, 전기가 연결되지 않으면 서비스를 확장할 수 없습니다. ②인프라 층이 ①R&D 층의 성과를 현실로 바꾸는 병목이 되는 이유입니다.

세 기업의 배포 전략이 왜 다른가: ④배포·제품 층

같은 “AI 서비스”인데 왜 방식이 다를까요? 각 기업이 가진 기존 자산이 다르기 때문입니다.

- OpenAI: 기존 사용자 기반이 없어서 ChatGPT라는 독립 제품을 만들어 직접 사용자를 모음

- Anthropic: 개발자 시장을 노려 Claude Code와 MCP로 기존 개발 워크플로에 침투

- Google: 검색·Gmail·Docs에 수십억 사용자가 이미 있어서 Gemini를 기존 제품에 통합

출발점이 다르면 배포 전략도 다릅니다. 모델(①)이 비슷해질수록, 이 배포 전략(④)의 차이가 기업의 운명을 가릅니다.

거버넌스가 실제로 제품을 바꾸는 사례: ⑥거버넌스 층

“규제”가 먼 이야기처럼 들릴 수 있지만, 실제로 기업의 제품 전략을 직접 바꿉니다.

- EU AI Act: AI를 위험 등급으로 분류. “고위험”이면 투명성 보고서와 감사 의무 발생 → 기업이 EU 시장에 별도 버전을 만들어야 함

- 저작권 소송: AI 훈련 데이터의 저작권 문제로 소송 진행 중 → 결과에 따라 훈련 데이터 확보 방식(①R&D)이 바뀔 수 있음

- 미국 행정 명령: 대형 모델 공개 전 안전 테스트 결과를 정부에 제출 의무 → 출시 일정에 직접 영향

규제는 “산업을 막는 것”이 아니라 “교차로의 신호등”에 가깝습니다. 신호등이 없으면 사고가 나서 더 느려집니다. 규제가 방향과 속도를 조율하면서 산업이 지속 가능하게 성장하는 구조를 만듭니다.

대표 장면: 같은 뉴스를 다르게 읽는 법

Before: “Anthropic이 Claude 4를 출시했다”는 뉴스를 보면, 가장 먼저 하는 것은 벤치마크 점수 확인이었습니다. MMLU 몇 점인지, HumanEval 몇 점인지, GPT-5보다 높은지 낮은지. 점수가 높으면 “Anthropic이 앞섰다”, 낮으면 “아직 멀었다”로 5분 만에 판단이 끝났습니다. 이 방식의 문제는 무엇인가? 벤치마크 점수는 ①R&D 층의 결과물일 뿐입니다. 나머지 5개 층(인프라, 추론 비용, 배포, 운영, 거버넌스)에 대해서는 아무것도 알 수 없습니다. 1등 모델을 가진 기업이 1등 AI 기업이 아닌 이유가 여기에 있습니다.

전환점: 같은 뉴스를 6층 스택으로 읽기 시작하면 질문이 달라집니다. “추론 비용은 얼마나 내려갔나?” (③), “Claude Code와 MCP 생태계에 어떻게 연결되나?” (④), “Anthropic의 데이터센터 전력은 Amazon/Google에 의존하는데 충분한가?” (②), “AGENTS.md나 에이전트 운영 도구는 어떻게 바뀌나?” (⑤), “EU AI Act에서 이 모델은 어떤 등급인가?” (⑥).

After: 모델 출시 뉴스 하나가 6개 질문으로 펼쳐집니다.

- “Claude 4의 벤치마크는?” → ①R&D (모델 성능)

- “Anthropic의 데이터센터 전력은 Amazon에 의존하는데 충분한가?” → ②인프라

- “Haiku급 저비용 모델은 같이 나왔나?” → ③추론 경제학

- “Claude Code와 MCP 생태계에 어떻게 연결되나?” → ④배포·제품

- “AGENTS.md나 에이전트 운영 도구는 업데이트됐나?” → ⑤운영

- “EU AI Act에서 이 모델은 어떤 등급인가?” → ⑥거버넌스

같은 기사를 읽어도 보이는 층이 완전히 달라집니다. 벤치마크 점수 비교에 5분 쓰던 시간이, 산업 구조 분석에 15분 쓰는 시간으로 바뀝니다. 깊이의 차이는 시간의 차이가 아니라 질문의 차이에서 옵니다.

한국 독자에게 왜 중요한가

한국은 반도체 생산에서 세계 최상위권이고, 삼성과 SK가 AI 인프라 층(②)에서 핵심 공급자 위치에 있습니다. 삼성전자의 HBM(고대역폭 메모리)은 AI 가속기의 필수 부품이고, SK하이닉스도 같은 시장에서 경쟁합니다. 이 두 기업의 동향은 AI 산업의 ② 인프라 층을 직접 좌우합니다.

네이버와 카카오는 배포·제품 층(④)에서 한국어 AI 서비스를 운영하고 있고, 네이버의 하이퍼클로바와 카카오의 AI 서비스는 한국 시장의 ④층 경쟁을 형성합니다.

한국 독자가 AI 산업 기사를 읽을 때, 이 6층 프레임을 적용하면 개별 뉴스가 산업 구조 안에서 어디에 위치하는지 바로 보입니다.

구체적으로 어떻게 연결되는가:

- “삼성전자 HBM 수주 증가” → ②인프라 층: HBM(High Bandwidth Memory)은 GPU 옆에 붙어서 대량의 데이터를 빠르게 주고받는 메모리입니다. AI 모델이 커질수록 더 많은 HBM이 필요합니다. NVIDIA가 GPU를 많이 팔면 삼성·SK하이닉스의 HBM도 비례해서 팔립니다. 한국 반도체가 AI 산업의 ②인프라 층을 직접 공급하는 구조입니다

- “네이버 하이퍼클로바 X 업데이트” → ①R&D 층: 한국어 특화 모델 경쟁. 하지만 진짜 질문은 “이 모델이 어떤 제품에 들어가는가”(④배포)

- “한국 데이터센터 전력 수요 급증” → ②인프라 층: 4편에서 본 전력 병목이 한국에서도 현실화

- “AI 기본법 논의” → ⑥거버넌스 층: 규제 프레임이 기업의 배포 전략을 바꿀 수 있음

- “SKT AI 서비스 도입률” → ④배포·제품 층: 도입률 숫자보다 “실제 워크플로가 바뀌었는가”가 중요

이렇게 읽으면 “뉴스”가 “산업 구조 분석”으로 바뀝니다. 한국은 ②인프라(HBM 공급)와 ④배포(네이버·카카오 AI 서비스) 양쪽에서 AI 산업에 참여하고 있기 때문에, 6층 프레임으로 읽으면 한국 기업의 위치가 글로벌 구조 안에서 어디인지가 명확해집니다.

특히 한국 반도체(②인프라)와 한국 AI 서비스(④배포)가 같은 전력 인프라를 공유한다는 점도 중요합니다. 삼성 평택 캠퍼스의 전력 수요와 수도권 데이터센터의 전력 수요가 같은 한전 계통에 실립니다. 1편에서 본 “같은 전력망 경쟁”이 한국에서도 일어나고 있습니다.

모델 경쟁 vs 스택 경쟁

모델 경쟁 (뉴스의 주인공)

벤치마크 점수

파라미터 수

새 아키텍처 발표

리더보드 순위 변동

스택 경쟁 (실제 산업 우위)

전력 계약·데이터센터 확보

추론 비용 절감 속도

기업 워크플로 통합 깊이

에이전트 운영 품질

규제 대응 속도

프론티어 모델 간 성능 격차가 줄수록, 스택 경쟁이 장기 우위를 결정한다

이 글을 읽고 나면 무엇이 달라지는가

| 주제 | 읽기 전 | 읽은 후 |

|---|---|---|

| AI 산업이란 | 모델 랭킹이 거의 전부 | R&D→인프라→추론비용→배포→운영→거버넌스의 6층 스택 |

| 모델 출시 뉴스 | 벤치마크 점수만 확인 | 추론 비용, 전력 확보, 기업 도입, 규제 영향까지 6개 질문 |

| 경쟁의 중심 | 어떤 모델이 1등인가 | 인프라 확보와 워크플로 통합이 장기 우위를 결정 |

| 비용 하락 | 좋은 일 | 좋은 일 + 사용량 폭발 + 전력 수요 급증의 양면 |

반론과 한계

“어떤 시기에는 모델 성능 격차가 산업 우위를 크게 좌우하지 않나?”라는 반론은 타당합니다. GPT-4 출시 직후처럼 하나의 모델이 시장을 뒤흔드는 순간은 실제로 있습니다. 그런 시기에는 ① 연구개발 층이 압도적으로 중요합니다.

하지만 시간이 지나면 후발 모델이 따라붙고, 성능 격차는 줄어듭니다. 2024~2025년이 바로 그 시기입니다. Claude, Gemini, Llama가 GPT-4를 따라잡으면서 프론티어 격차가 크게 좁아졌습니다. 이렇게 격차가 줄어든 시기에는 인프라, 추론 비용, 배포, 운영 층의 경쟁이 장기 우위를 결정합니다.

또 하나의 한계: 6층 프레임이 모든 AI 기업에 동일하게 적용되지는 않습니다. 스타트업은 주로 ①+④에 집중하고, 빅테크는 ②+④를 함께 키우며, 반도체 기업은 ②에 특화됩니다. 이 프레임은 산업 전체를 읽는 지도이지, 모든 기업을 같은 잣대로 재는 도구가 아닙니다.

시리즈 안내

이 글은 미래산업 카테고리 2편입니다. 다음 글에서는 휴머노이드 로봇이 독립 시장인지, 기존 자동화의 다음 층인지를 다룹니다. AI 축에서 로봇 축으로 시야를 넓히는 단계입니다.

여기까지 읽으면 무엇이 쌓이는가

1편에서 미래산업의 3축(AI·로봇·에너지)이 왜 같이 보여야 하는지를 봤습니다. 이 글(2편)에서는 그 중 AI 축 하나를 6층으로 분해했습니다. 이제 AI 뉴스를 읽을 때 모델 점수 외에 5개 층을 더 볼 수 있게 됐습니다.

하지만 AI 축만 봐서는 1편에서 말한 “3축이 같이 봐야 하는 이유”가 완성되지 않습니다. 3편에서 로봇 축을 봐야 “물리 실행 층”이 채워지고, 4~5편에서 에너지 축을 봐야 “속도 제한 층”이 채워집니다. 6편에서 세 축이 공장에서 만나는 장면을 보면 1편의 3층 구조가 구체적인 메커니즘으로 완성됩니다.

1편에서 3층 구조(AI·로봇·에너지)를 봤고, 이 글(2편)에서 AI 축을 6층으로 분해했습니다. 다음 3편에서는 로봇 축으로 넘어갑니다. 466만 대의 설치 기반 위에 휴머노이드가 어떤 조건을 증명해야 하는지, 데모와 상용화의 간극이 왜 넓은지를 봅니다.

← 이전 글: 미래산업 입문 지도

자주 묻는 질문

Q: AI 산업을 공부하려면 모델 랭킹부터 봐야 하나요?

A: 모델 랭킹은 출발점으로는 괜찮습니다. “지금 어떤 모델이 잘 나가는가”를 확인하는 거니까요. 하지만 거기서 끝나면 6층 건물의 1층 설계도만 본 것과 같습니다. “이 모델을 돌리는 데이터센터의 전력은?”(②인프라), “추론 비용이 기업이 감당할 수준인가?”(③추론 경제학), “어떤 제품에 실제로 들어가는가?”(④배포), “배포 후 품질 유지는?”(⑤운영), “규제에 걸리지 않는가?”(⑥거버넌스)——이 5개 질문을 추가하면 산업 전체가 보이기 시작합니다.

Q: 6개 층 중 지금 가장 경쟁이 치열한 곳은 어디인가요?

A: 2026년 현재, ②인프라(전력·데이터센터 확보)와 ④배포·제품(에이전트·워크플로 통합)에서 경쟁이 특히 치열합니다. 왜 이 두 층인가? ②인프라는 물리적으로 확보하기 어렵기 때문입니다(변압기 4년, 큐 2,500GW). 선점하면 후발 주자가 따라잡기 힘듭니다. ④배포는 “모델을 실제 돈으로 바꾸는 층”이기 때문입니다. 아무리 좋은 모델이라도 사람들이 실제로 쓰게 만들지 못하면 매출이 안 납니다. 모델 성능이 비슷해질수록 이 두 층에서의 차이가 기업의 명운을 가릅니다.

Q: 추론 비용이 왜 중요한가요?

A: 추론 비용은 “AI를 한 번 쓰는 데 드는 전기·서버·네트워크 비용”입니다. 이 비용이 높으면 소수의 대기업만 AI를 쓸 수 있고, 비용이 낮으면 모든 기업이 쓸 수 있습니다. GPT-3.5급 추론 비용이 280배 내려간 것은, 이전에 대기업만 쓸 수 있던 AI를 중소기업도 쓸 수 있게 됐다는 뜻입니다. 이 “접근성 확대”가 기업 도입률 78%의 배경입니다. 비용이 더 내려가면 사용량이 더 폭발하고, 데이터센터와 전력 수요가 더 급증합니다. 산업의 성장 속도를 결정하는 가장 직접적인 변수입니다.

Q: 이 프레임은 OpenAI, Google, Anthropic 같은 기업에도 적용되나요?

A: 네. 예를 들어 OpenAI는 ①R&D가 강하지만 ②인프라를 Microsoft에 의존합니다. 확장 속도가 Microsoft Azure의 데이터센터 전력에 묶인다는 뜻입니다. 반대로 Google은 ②인프라(자체 TPU + 대규모 DC)가 강하지만, ④배포에서 ChatGPT에 밀립니다. 이렇게 “어디가 강하고 어디가 약한가”를 6층으로 보면, “이 기업의 다음 전략은 뭘까”까지 추론할 수 있게 됩니다.

Q: 이 블로그의 AI 도구 리뷰와 미래산업 카테고리는 어떻게 연결되나요?

A: AI 도구 리뷰는 ④배포·제품과 ⑤운영 층을 직접 다룹니다. 미래산업 카테고리는 ①~⑥ 전체를 산업 구조로 읽는 관점을 제공합니다. 둘은 같은 스택의 다른 층을 보는 것입니다.

회원 등록(무료)으로 매주 월요일 뉴스레터 받기 → 등록하기

저자: VibeCoding Tailor (shuntailor.net 운영. AI 도구 실무 활용과 미래산업 구조 해설을 일본어·한국어로 발신 중. Lovable 공식 앰버서더.)

이 글을 다 읽은 뒤 해볼 것

오늘 AI 뉴스를 하나 찾아서, 6층 체크리스트의 질문 중 하나만 던져 보세요. “이 발표는 6층 중 어느 층의 이야기인가?”——이 질문 하나만으로도 뉴스를 읽는 깊이가 달라지는 걸 체감할 수 있습니다.

이 글에서 사용한 데이터의 출처

이 시리즈의 숫자는 모두 1차 데이터(공인 기관이 직접 수집·분석한 데이터)에서 가져왔습니다. 1,091억 달러(투자), 78%(도입률), 280배(비용 하락), 90%(기업 출신 모델)——이 숫자들은 Stanford HAI의 연례 보고서에서 나왔습니다. 뉴스 기사의 추정치가 아닙니다.

소스 목록

- Stanford HAI — AI Index Report 2025

- IEA — Electricity 2025

- Artificial Analysis — LLM Benchmarks & Pricing