LLM学習。LLM理論集中コース · 2編

1-A編 (重み 80億個の正体) を読んでない方は先にどうぞ。

1-A編を読み終えると自然に浮かぶ質問があります。私もそうでした。

「その80億個の数字は一体誰が、どう決めたの? 人が一つ一つ決めたわけはないだろうに。」

結論から言うと — 人が決めません。データが決めます。 これが学習です。

この記事ではその学習が実際にどう起こるのかを最後まで追いかけます。山を下る登山者の比喩から始まり、最後は 「なぜAI学習が都市1つ分の電気を食うのか」 まで到達します。一緒に行きましょう。

今回つかむ3つのポイント:

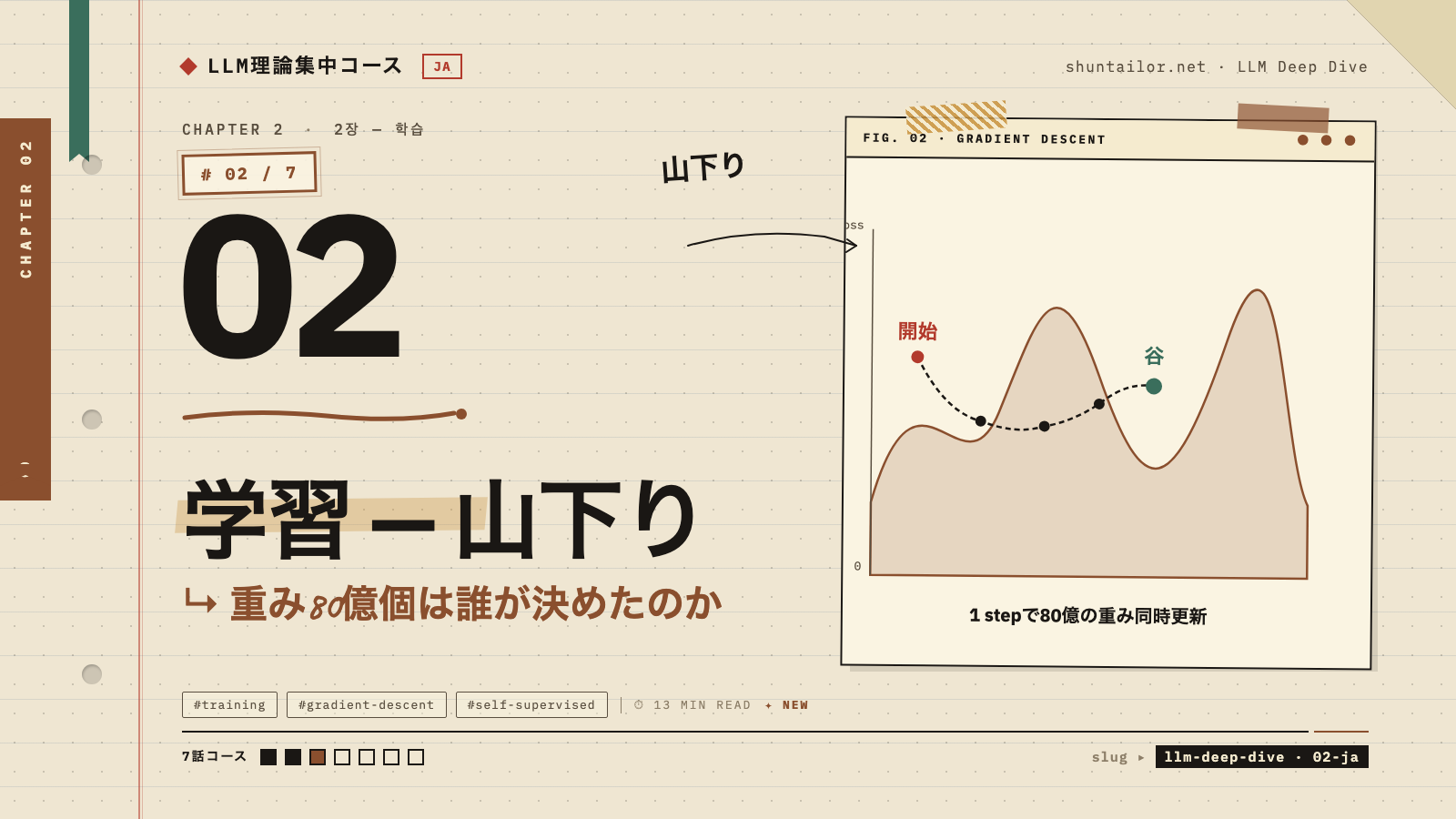

1. 学習が「山下り」とは具体的に何か

2. 1 step で80億の重みがどう一度に動くか

3. AI学習がなぜ資本·半導体·電力競争になったか

まずは直感から — 山を下る登山者

目を閉じた登山者が山頂に立っているとします。目標は 最も低い谷 に下りること。目が見えないので地図も読めない。できることはたった一つ。

足元を探って、今この場所から最も急に下る方向に一歩だけ踏み出す。

一歩踏み出して、また足元を探って、また最も急な方向に一歩。これを無限に繰り返す。

これが 勾配降下法 (Gradient Descent) です。AI学習の核心アルゴリズム。名前は仰々しいですがやってることはこれだけ。今の位置から最も急に下る方向に一歩ずつ動く。

ところで、この比喩を聞きながら正直最初に「山ってどこにあるの?」と思いました。登山者は分かるけど山は? それが詰まった最初のポイントでした。なので山から押さえて行きます。

山って一体何?

山 = 間違い度合い (loss) の風景 です。

1-A編のスパムメールモデルに戻りましょう。重みが3個ありました。当選 +2.0、会議 -1.5、感嘆符 +0.3。でも最初はこの数字を知りません。知るすべがない。学習開始前なので。ランダムで始めます。 例えばこう。

最初の重み: [当選: 0.1, 会議: 0.1, 感嘆符: 0.1] ← 適当

この重みで正解が付いたメール1万通を回してみます。結果は当然めちゃくちゃ。「スパムなのに正常に分類」「正常なのにスパムに分類」がたくさん出る。

このとき 間違い度合いを数字で数えます。

1万通中 5,234通間違い → 間違い度合い = 5234

この「5234」が山の 高さ です。重みを変えるとこの数字が変わる。

重み [0.5, 0.1, 0.1] · 山の高さ 4800 ← 一歩下りた

重み [1.2, -0.5, 0.2] · 山の高さ 800 ← さらに下りた

重み [2.0, -1.5, 0.3] · 山の高さ 100 ← ほぼ谷!

→ 重みを変える = 山の上で位置を移す。

→ 間違い度合いが減る = 山を下る。

学習というのは結局この一行。間違い度合いが最も小さくなる重みを見つける = 山の最も低い谷を見つける。

ちょっと、これ学習の話? 推論の話?

ここで一度立ち止まりました。1-A編で「重みは学習が終われば固定される」と言ったじゃないですか。なのに今は重みを変えている? じゃあこれは 学習段階の話なのか推論段階の話なのか 紛らわしい。

これは本当に紛らわしいので押さえて進みます。答えは 100% 学習段階の話 です。

| 段階 | 何をする | 重みは? |

|---|---|---|

| 学習 (Training) | データで重みを 作る | 変わり続ける |

| 推論 (Inference) | 作った重みを 使う | 固定 (絶対変わらない) |

ここまで話した「山下り」 = 学習段階でだけ起こることです。

ChatGPTを我々が使うとき(これが推論)重みは1ビットも変わりません。すでにOpenAIが学習段階で全部決めてある80億個(あるいはもっと多くの)数字がそのまま貼り付いていて、我々の質問はその固定された数字の間を 一回通過 して答えを作る。

比喩で言うとこう。

- 学習 = 料理レシピを何万回も試行錯誤して完成させる過程

- 推論 = 完成したレシピで一回料理する

この記事で扱うのは全部学習の話。推論は3編で別に扱います。

これを押さえて進まないと次が紛らわしくなります。重みを変える話は全部学習段階の中だけで起こること。

足元をどう探るって?

登山者に戻って。「足元を探る」が実際に何かというと。

答えは 重みをほんの少し揺らしてみて、間違い度合いがどう変わるかを見る こと。

具体的に。

今の重み: [当選: 0.1, 会議: 0.1, 感嘆符: 0.1] → 間違い度合い 5234

質問1: 「当選」重みだけ 0.1 → 0.11 に少し上げると?

実験: [0.11, 0.1, 0.1] → 間違い度合い 5230 (4 減った!)

質問2: 「会議」重みだけ 0.1 → 0.11 に少し上げると?

実験: [0.1, 0.11, 0.1] → 間違い度合い 5240 (10 増えた!)

質問3: 「感嘆符」重みだけ 0.1 → 0.11 に少し上げると?

実験: [0.1, 0.1, 0.11] → 間違い度合い 5233 (1 減った)

この実験結果が 「足元の傾き」 です。各重みを微小に揺らしたとき山の高さがどう変わったか。

- 「当選」は上げると山の高さが確実に減る → もっと上げるべき

- 「会議」は上げると山の高さが増える → 逆に下げるべき

- 「感嘆符」は上げると少し減る → 少しだけ上げる

これを一度に全ての重みに適用して一歩踏み出します。

一歩後: [当選: 0.5, 会議: 0.05, 感嘆符: 0.12] → 間違い度合い 4500

山が 5234 → 4500 に下りた。一歩成功。

重みを揺らしたら山が上がってしまう場合は?

これが次に浮かぶ質問。「下るとしか言ってないけど、間違って上がる場合もあるんじゃない?」

当然あります。実はよくある。3つに分けて見るといい。

1つ目、一歩が大きすぎたとき。

足元の傾きを見て「右が下り」と判断して一歩動いたけど、大きすぎる一歩で谷を飛び越えて反対側の斜面に上がってしまう。

山の高さの変化:

5234 → 4500 → 3200 → 1500 → 800 → 200 → 1100 (あれ、上がった!)

↑

一歩が大きすぎた

これを 発散 (diverge) と言います。一歩のサイズを 学習率 (learning rate) と呼ぶのですが、これが大きすぎると谷を飛び越え、小さすぎると永遠に着かない。学習率調整がAI学習で最も難しい部分の一つです。後でもっと詳しく扱います。

2つ目、足元の測定自体が不正確なとき。

実際の学習は1万通全部見て傾きを測るのではなく、一部だけランダムに選んで測ります。標本なので傾き測定にノイズが混じる。たまに間違って測った傾き方向に一歩動くと山の高さが上がります。

一歩ごと:

4500 → 4200 → 4350 (少し上がった) → 4100 → 4000 → 4150 → 3800 ...

全体傾向は下りていくけど途中で上がる。これが正常です。学習が終わるまで山の高さはギザギザに振動しながら徐々に下がっていく。

量子化ビットと学習率は同じ?

ここで正直紛らわしかった。「一歩のサイズを微細にするには量子化ビット数を上げればいい?」と直感的に思ったんです。1-A編で量子化という言葉が出たので。

違います。両者は完全に別の話です。 押さえて進みます。

- 学習時の精度: 常に32ビット(または16ビット)で計算。重み1個が32ビットの少数。この精度でないと足元の傾きを正確に測れません。

- 量子化: 学習が終わったあと、32ビットで保存された重みを8ビットや4ビットに 圧縮 する作業。モデルファイルを小さくして推論速度を上げるため。

原本 (32ビット): 0.347291482763

8ビット量子化: 0.35

4ビット量子化: 0.3

量子化のビットを上げると 推論時 に重みがより精密に保存されるという意味。学習中の一歩のサイズとは全く別の話。

整理:

- 学習率 (learning rate) = 学習中の一歩のサイズ。学習段階の話。

- 量子化 (quantization) = 学習済みモデルを推論用に圧縮するときの精度。推論段階の話。

同じ「精度」という言葉でも別の段階の話。混同しないで。

一度に80億個全部揺らすの?

次の質問。重みが80億個なら、80億個を一つずつ全部揺らしてみないといけないってこと? それで一回山下りるのにどれだけかかる?

ここが本当のマジックです。80億の重み全ての傾きを一度に計算して、一度に同時に一歩動きます。 これが可能なのは 逆伝播 (backpropagation) というアルゴリズムのおかげ。

逆伝播のマジックはこれ。

80億個の重みそれぞれを一つずつ揺らしてみなくても、一回の計算の流れ で80億個の傾きを同時に全部分かる。

原理は微分の連鎖律(chain rule)ですが、数学を抜いた直感だけ。これは 会社の部署別責任追及の比喩 で押さえるとよく分かる。

逆伝播 = 会社の部署別責任追及

会社の四半期業績が良くなくて責任の所在を探すとします。

原材料 → 生産部 → 加工部 → 組立部 → マーケ部 → 売上

↓

売上 -1億 (目標未達)

部署を一つずつ逆に追及していく。

1段階、マーケ部追及。

「売上 -1億 の直接原因はマーケ部だ。」マーケ部責任 = 100%。

マーケ部の中の社員 A·B·C·D の中で誰の責任か再分解。A が30%、B が20%、C が40%、D が10%。

→ 「マーケ部 100% のうち A が30% → A の真の責任 = 30%」

2段階、マーケ部に入った入力は組立部の成果物だった。

「マーケ部が -1億 を作ったうち組立部入力が70%影響だった。」 → 組立部責任 = 70%。

3段階、組立部に入った入力は加工部の成果物。

組立部 70% のうち加工部影響 50%。 → 加工部責任 = 70% × 50% = 35%。

4段階、生産部。

加工部 35% のうち生産部影響 80%。 → 生産部責任 = 35% × 80% = 28%。

このように逆に遡りながら責任を掛け算で分解していく。これが 連鎖律 (chain rule) = 「鎖のように責任が繋がる」 ということ。

LLM で同じことが起こります。

入力 → 1層 → 2層 → … → 32層 → 出力 → 間違い度合い 100

[逆方向 = 責任追及]

間違い度合い 100

↓ 32層に分配

32層の重みたち自分の分を受け取る

↓ 31層に分配 (32層責任 × 31→32 影響)

31層の重みたち自分の分を受け取る

↓ … 遡り続ける …

↓

1層到達 — 全80億の重みが自分の傾きを受け取る

各重みが「自分が間違い度合いにどれだけ寄与したか」という自分の傾きを受け取る。この傾きの方向の逆に一歩動けば山が下りる。

不思議なのは、80億個を別々に揺らさなくても、一回の掛け算チェーンの流れ で80億個の責任が全部分配される。ライプニッツとニュートンが作った微積分の核心がこれだった。

GPU はどうやって速くする?

ここで GPU の登場。4096次元を一度に調節するとしても、1677万個の掛け算(1層内の重みの数)をどうやって同時にする?

GPU の本質を押さえます。

- CPU = 一度に1個の計算を非常に速く

- GPU = 一度に 数千個を同時に 計算 (各々は CPU より遅くてOK)

LLM の1層は 4096 × 4096 = 1677万個の掛け算があるけど、GPU は数千個ずつ並列に分けて同時に回します。人間が分けるのではなく GPU が自動で。

1677万個の掛け算

↓ GPU が自動で分割

数千個ずつ同時処理 → 数千個ずつ同時処理 → ... (繰り返し)

↓ 0.001秒後

完了

ところでまた一つ紛らわしいのが。「じゃあ32層も一度にできる?」

答えは いいえ。層同士は順番です。

理由は逆伝播の特性。32層の傾きを知らないと31層の傾きが分からない(連鎖律の掛け算チェーン)。だから層は順次に逆向きに解いていかないといけない。

整理:

- 数学的に: 1層内の1677万個の重みは同時処理

- 物理的に: GPU が数千個ずつ分けて処理するけど速すぎて事実上同時

- 層同士は?: 順番 (逆伝播特性上)

層は順次、層内は同時。 こう押さえる。

1 step の正体 — 正直最初は紛らわしかった

ここで本当に大事なことが。私も最初は1 step が1層処理を指すと思ってました。違います。

1 step = データ1束を最初から最後まで全て処理して、80億の重みを一度更新すること

詳細ステップで分けるとこう。

[1 step の中身]

1. データ1束を取得 (これを「ミニバッチ」という)

2. 順方向: 1層 → 2層 → ... → 32層 → 出力

3. 間違い度合いを測定

4. 逆方向: 32層 → 31層 → ... → 1層 (80億の傾き全部得る)

5. 80億の重みを一度に更新

↑

ここまでが 1 step

1層処理 = step じゃない。 1層処理はただ「1層通過」するだけ。32層全部通過 + 逆伝播 + 重み更新まで全部終わって初めて step 1回。

これを押さえると次の衝撃が来ます。この 1 step を LLM は 数十万 ~ 数百万回 繰り返します。

| モデル | 学習 step 数 (大まか) |

|---|---|

| 小さい実験モデル | 数万 ~ 数十万 |

| GPT-2 (15億) | 数十万 |

| LLaMA 2 (70億) | 約 50万 ~ 100万 |

| GPT-3 (1750億) | 数百万 |

| GPT-4 推定 | 数百万 ~ 数千万 |

数十万から数百万回。「数万回くらい?」と思ったら一桁上に行ってください。

今週のAI動向

ミニバッチ — 全部見ちゃダメ?

step の話で「ミニバッチ」という言葉が出ました。これが何かというと、学習データ全体から 一部だけランダムに取り出して 1 step に使うこと。

全学習データ: 1兆個のトークン (インターネットテキスト全部)

ミニバッチ: そのうち一部だけ取り出して 1 step に使用

自然に疑問が湧きます。「なぜ全部見ずに一部だけ? 全部見れば正確じゃない?」

いい質問。これは1960年代から50年議論された本物の問題です。3つの方式が歴史的にあった。

方式 A、全部見る (Batch Gradient Descent)。

– 1 step ごとに1兆個のトークン全部計算

– 長所: 傾きが正確 (ノイズなし)

– 短所: 1 step に数時間~数日。数百万 step 回したら宇宙が終わる

方式 B、1個ずつ見る (Stochastic Gradient Descent)。

– 1 step ごとに1個のトークンだけ計算

– 長所: 1 step が非常に速い

– 短所: 傾きがあまりに不正確 (1個で山全体の傾き推定?)

方式 C、ミニバッチ (Mini-batch)。

– 128個 ~ 数万個ずつ取って計算

– A の正確性と B の速度の バランス

– 現代の標準

ミニバッチサイズは誰が決めるか。人(研究者)が学習開始前に決めます。 こういうのを ハイパーパラメータ (hyperparameter) と呼びます。

パラメータ = 学習中に自動で決まる数 (= 重み、バイアス)

ハイパーパラメータ = 学習開始前に人が決める数 (= ミニバッチサイズ、学習率、層の数 など)

「ハイパー」は「上にある」という意味。重みたちの上で学習自体を操る数なので。

LLM のミニバッチは実はとてつもなく大きい。一般的な直感では「128個くらい」と思いがちですが、実際の LLM は 1 step に数百万トークンを見ます。LLaMA のような大きなモデルはミニバッチが約400万トークン。だから GPU が数万台必要。1台ではそんな大きなミニバッチをメモリに載せられない。

もう一つ不思議なのが、ミニバッチノイズは実は役に立つ。偽の谷に落ちてもノイズで弾き出されて本当の谷へ転がっていける。ノイズが薬になる珍しいケース です。

学習率 — 一歩のサイズ

前で発散の話のとき少し出てきた、一歩のサイズ、学習率。

新しい重み = 現在の重み - (学習率 × 傾き)

↑

これが学習率

大きすぎると発散、小さすぎると永遠に着かない。図で見ると。

学習率小さすぎ:

5234 → 5230 → 5226 → 5222 → ...

(永遠に谷に着かない)

学習率適切:

5234 → 4500 → 3200 → 1500 → 800 → 200 → 100

(効率的に着く)

学習率大きすぎ:

5234 → 4500 → 1100 → 8000 → 50000 → ∞

(発散。山を飛び越えてもっと高い所へ弾き飛ぶ)

ここで本当に面白いのが。学習率は学習途中で変えます。

学習開始 (ランダム重み、山の上): 大きい学習率 (例: 0.001)

中盤: 徐々に減らす

終盤 (もう谷の近く): 小さい学習率 (例: 0.00001)

これを 学習率スケジュール (learning rate schedule) と言います。比喩で言うなら、山の上では大股で速く下り、谷の近くでは小さい歩幅で精密に到着。山岳登山の常識と同じ。

最初の学習率自体はどう決めるか。先行研究を参考に、小さなモデルで 0.0001·0.0003·0.001·0.003 などを試して経験で決める。GPT-4 のような巨大モデルは最初の学習率を間違えると1億ドルを丸ごと無駄にします。だから学習開始前に小さなモデルで沢山実験する。

じゃあ間違い度合いが0になるまで学習するの?

これが自然に出る次の質問。「山を完全に下りきれば0でしょ? 0になるまでやればいい?」

違います。0までは行きません。行ってもいけない。

3つの理由がある。

1つ目、0に到達不可能。

LLM の山は 80億次元の空間 です。その中の本当の最低点(global minimum)は宇宙が終わっても見つけられない。代わりに「十分低い谷」に着いたら終わり。

2つ目、0になるとむしろ壊れる。

これが本当に大事な概念。例で行きます。

スパムモデルを学習データ1万通で訓練して、学習データで 間違い度合い 0 まで行ったとしましょう。モデルが1万通を100%当てる。完璧?

でも 新しいメール1通 が入ると無残に外す。なぜ?

モデルが「スパムの本質」を学んだのではなく、その1万通のささいな特徴まで暗記してしまった からです。例えば。

- 「送信者メールが kim×××@… で終わればスパム」 ← 学習データではたまたまそうだっただけ

- 「メール長が正確に327字なら正常」 ← たまたまそうだっただけ

新しいメールでこういう偶然は通用しないのでガラガラ崩れる。これを 過学習 (overfitting) と言う。

比喩で言うなら、試験の問題集を暗記すればその問題集は100点だけど本物の試験では落ちる。暗記せず原理を学ぶべき。同じこと。

3つ目、なので学習は常に適切な所で止める。

実際の学習は2つの山の高さを同時に見る。

学習データの山の高さ (training loss)

検証データの山の高さ (validation loss) ← モデルが見たことないデータ

学習が進むにつれて学習データの山の高さは下がり続ける。でも検証データの山の高さは。

最初: 両方一緒に下がる (よく学んでいる)

中盤: 学習 ↓、検証も ↓ (改善継続)

ある瞬間: 学習 ↓、検証 ↑ (暗記開始 = 過学習)

検証の山の高さが再び上がり始めた瞬間に 学習を止める。 これを 早期停止 (early stopping) と言う。その時点がモデルの本物の谷。

検証データは別に取っておくの?

はい。学習開始前に予め切り分けておきます。

全データ

├─ 学習用 (Training): 98% (9800億個)

├─ 検証用 (Validation): 1% (100億個)

└─ テスト用 (Test): 1% (100億個)

3つのデータの役割が違います。

- 学習用: 重みを直接更新するのに使用。モデルが見たデータ。

- 検証用: 学習途中で「今モデルが汎化してるか」チェック。モデルが見たことないデータ。検証の山が上がり始めたら学習を止める。

- テスト用: 学習終了後 1回だけ 使う最終試験。検証用でハイパーパラメータ調整しているうちに検証データにも間接的に過学習する可能性がある。なので完全に手付かずのデータを別に取っておいて最後に評価。

比喩で整理すると。

- 学習データ = 普段解く問題集

- 検証データ = 模擬試験

- テストデータ = 本番試験 (1回だけ、本物の実力)

じゃあ正解は誰が付けたの?

ここがこの編の本物のマジックです。自然な疑問。「インターネットテキストに『これは正解、あれは不正解』みたいな印があるはずないでしょ?」

答え: 次の単語が正解です。

これを 自己教師あり学習 (self-supervised learning) と言う。データ自体から正解が自動で作られる。

どうやって。インターネット文を一つ持ってきましょう。

「今日の天気は本当に良い」

これをトークンに分けて、前部分を入力 / 後部分を正解 に自動生成。

入力: 「今日の」 → 正解: 「天気は」

入力: 「今日の天気は」 → 正解: 「本当に」

入力: 「今日の天気は本当に」 → 正解: 「良い」

1つの文から学習データ3個が自動で出てくる。人がラベリングしない。文自体が正解を含んでいる。

学習が進む様子はこう。

入力: 「今日の天気は本当に」

モデルが12万8千個のトークン各々の確率を出力:

「良い」 → 23% ← モデル予測

「多い」 → 8%

「寒い」 → 4%

「暑い」 → 3%

...

正解: 「良い」

間違い度合い = 「良い」確率が100%でない分 (例: 77 違う)

この間違い度合いを減らすために80億の重みを調整。インターネット文1兆個に対してこれを繰り返せば、モデルが次の単語をうまく予測できるようになる。これがLLM完成。

次の単語予測一つだけでモデルは世界のほぼ全パターンを学びます。

- 「日本の首都は ___」 → 「東京」をうまく予測 → モデルが地理を学ぶ

- 「1+1=___」 → 「2」をうまく予測 → モデルが算数を学ぶ

- 「ピタゴラスの定理は ___」 → モデルが数学を学ぶ

- 「今日気分が悪い。だから私は ___」 → モデルが感情と因果を学ぶ

次の単語をうまく当てるためには結局世界を理解しないといけない というのがLLMの核心哲学。

自己教師あり学習が革命的な理由は 人のラベルが0個 だということ。インターネットテキストをただ流し込むだけ。GPT-3 の学習データが約5000億トークン、本数百万冊分。人がラベリングしていたら不可能だった量。自己教師ありだから可能になった。

このシンプルな違いが 2017年 Transformer 登場 → 2020年 GPT-3 → 2026年 GPT-5.5 へと続いた AI 革命の出発点。

それで — 学習は結局資本主義

さて大きな絵を見ましょう。

ここまで整理した学習1サイクルはこう。

ミニバッチ → 32層順方向 → 間違い度合い → 32層逆伝播 → 80億の重み更新

↓

1 step 完了

これを 数十万 ~ 数百万回 繰り返す。

これを GPU 時間に換算するとどうなるか。

1 step ≈ 1~2秒 (数千 GPU 同時)

全学習: 50万 step × 1~2秒 = 1~3週間

GPU 1台で? 数十年

GPT-4 (推定)

GPU 25,000台 × 90~100日 フル稼働

電力: 約 50,000 MWh = 小都市1年分の電力

費用: 約 1億ドル (約150億円) 推定

GPT-3 (2020)

電力: 約 1,287 MWh

= 日本の4人世帯 約2,860世帯の月間電力

ここから自然に産業構造が見えてくる。

H200 GPU 1台の価格が約400万円。GPT-4 学習用 GPU 25,000台ならそれだけで約1000億円分の GPU。電気は別、冷却は別、データセンター用地も別。

だから GPU を多く持っている会社が LLM 開発競争で勝つ。資本がそのままモデル性能に直結。

これがこの数年起こったことの本質です。

- Anthropic ↔ AWS 1000億ドル10年契約

- Google → Anthropic 400億ドル投資

- NVIDIA 時価総額4兆ドル突破

- TSMC が米国·日本に新ファブを建てる理由

- データセンター電力不足 → 米国原発再稼働

- アップルがハードウェア出身 CEO を選んだ理由

全部同じ流れです。

AI モデル競争

↓

GPU 競争 (半導体競争)

↓

電力競争 (原発·太陽光·バッテリー·送電網)

↓

製造業·建設·素材競争

なので今、未来産業を見るには AI·ロボット·エネルギー 3軸を一緒に見る必要があります。別々には見えない。学習1 step に GPU 数千台が必要だという事実一つから全世界の電力網再編まで一行でつながる。

1-A編を読んだ時はまだ重みはただの不思議な数字だったでしょう。2編を読み終えた今、重み80億個を作るために人類が都市1つ分の電気を燃やしているということを理解しました。これがLLMを理解するということの本当の意味です。

ポイント整理 — 3つのテイクアウェイ

今回の編を一行で整理すると。

学習 = 80億の重みをデータに合わせて山を下るように調整すること。そしてこれが都市1つ分の電気を食う。

具体的に。

- 学習は山下りだ。 山 = 間違い度合い (loss)、位置 = 重みの値。1 step = ミニバッチ1個 + 32層順方向 + 逆伝播 + 80億の重み一度に更新。これを数十万~数百万回繰り返す。

- 正解は人が付けない。 次の単語が正解 (自己教師あり学習)。だからインターネットテキスト1兆個を人ラベル0個で学習できる。

- 学習 = 資本·半導体·電力競争。 GPT-4 学習1回 = 都市1年分の電力 = 1億ドル。AI 市場がクラウドビッグテックの資本競争になった本当の理由。

よくある質問

Q. パラメータと重みは同義語?

ほぼ同義語。日常的には同じように使ってOK。厳密にはパラメータ = 重み + バイアス(bias)。重みは入力に掛けられる数、バイアスは掛けた結果に足される数。重みが99%以上、バイアスは少数なので、日常会話では同じものとして見て問題ない。

Q. 量子化ビットと学習精度は別の話?

別の話。学習中は32ビット(または16ビット)で精密に計算し、学習が終わったあと推論用に8ビットや4ビットに圧縮するのが量子化。学習中の一歩のサイズは学習率で量子化ではない。

Q. 層を強化すればもっと早く0に到達する?

学習データではそう。でもそれが良いモデルではない。層/次元が多いほど暗記できる量が増えるので学習データでは早く0になるが、検証データではむしろ壊れる(過学習)。だから大きなモデルはデータも一緒にとてつもなく増やす必要がある。GPT-4 がうまくいく理由 = 1兆の重み + それに見合うデータ。両者が揃わないといけない。

Q. 「層を強化する」って具体的に何?

2つに解釈できる。(A) 層の数を増やす (32層 → 64層)。(B) 1層をもっと厚くする (4096次元 → 8192次元)。両方ともモデル表現力を高める方法で、両方とも重みの数が増えるのが本質。llama3-8b は 32層 × 4096次元、llama3-70b は 80層 × 8192次元。

Q. AI学習に本当にそんなに電気が要る?

GPT-3 学習1回 ≈ 1,287 MWh ≈ 日本の4人世帯約2,860世帯の月間電力。GPT-4 はその40倍。AI産業がクラウドビッグテックの資本競争になった理由がここ。

次の記事

3編: 推論 (Inference)

学習が終わったモデルがどう答えを作るか。重みは変わらないという事実が推論中にどう機能するか。我々が ChatGPT で見る「答えが一文字ずつ出てくる」あの現象の正体まで扱います。

その後は Attention(4編) → Transformer(5編) → 量子化·RAG·Fine-tuning(6編) の順に続きます。エンコーダとデコーダが重みをどう使うかもそこで本格的に扱います。

ソースリスト / Sources

- Andrej Karpathy, “Intro to Large Language Models” — YouTube

- 3Blue1Brown, “Backpropagation, intuitively” — YouTube

- David Patterson et al., “Carbon Emissions and Large Neural Network Training” — arXiv:2104.10350

- Meta AI, “Llama 3 training report” — 公式ブログ

- 「AIブームはなぜ電力問題につながるのか」 — shuntailor.net

著者: VibeCoding Tailor (テイラー)

shuntailor.net 運営。高麗大学 新素材工学専攻。AI ツール·バイブコーディングを実務目線で解説。Lovable 公式アンバサダー。累計受講生300名+のAI講義経験。日本語·韓国語バイリンガル。